我們對於世界的預期,是從自身經驗所衍生出的預測與直覺。有時候,我們因為預測成真而感到高興,卻容易陷入確認偏誤(confirmation bias)。要避免犯錯,就要問自己一個有些矛盾的問題:「這跟我預測的一樣嗎?」如果答案是「是,這跟我預測的一模一樣」,那就代表你應該確認得更多,而不是更少。

我們對於世界的預期,是從自身經驗所衍生出的預測與直覺。你的手機的自動完成功能,是使用人類語言常見字序的模型,猜測你接下來要輸入什麼字。我們也是依據累積的經驗,形成一個世界模型,就能更準確預測近期可能發生的事。

預測是人理解事物的關鍵。明明如此重要,我們卻往往沒發現,預測其實會深深影響我們對世界的解讀。即使是察覺到移動的物體這樣簡單的事情,也需要預測才能完成。大腦需要時間處理我們看見的光,所以我們感覺到的「現在」發生的事情,其實比「現在」延遲了幾百分之一秒。若是不想被車子撞,那需要掌握的並不是車子剛剛在哪裡,而是現在在哪裡,以及稍後會在哪裡。但等到掌握所需的視覺資訊,就來不及了,所以大腦必須使用類似「自動完成」的功能,預測車子稍後所在的位置。人面對移動物體的經驗豐富,而且向來就知道物體不會突然出現,也不會突然不見,因此可以建立一個有效的預測模型。要預測複雜得多,更久以後的行為、決策與行動,也是依循同樣的原則。

我們對於動作的預測若是出錯,就會被撞。對世界將會發生的事情的預測出錯,就會感到意外。而一旦感到意外,自然就會懷疑,但經驗若是符合預測,通常就不會質疑。人不能什麼都懷疑。同樣的道理,若是什麼都接受,就無法理解這個世界。我們必須做出預測。從經驗歸納出預期,再據此解讀所遇見的事物,而預期通常能讓人專注在重要的資訊上。

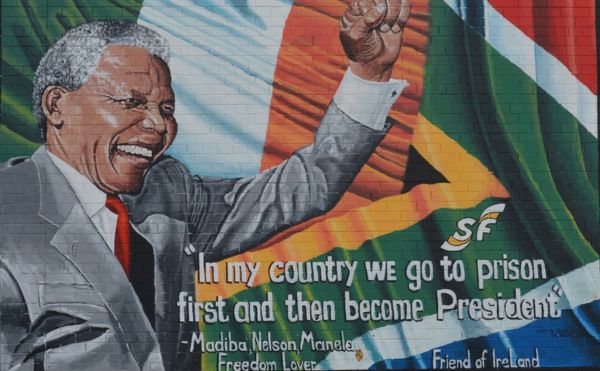

圖片來源:pixabay

有時候,我們因為預測成真而感到高興,卻容易陷入確認偏誤(confirmation bias)。存心推銷的人就會利用確認偏誤這個弱點,刻意將「產品」塑造成我們想要,也符合我們預期的樣子。精明的騙子知道漢娜.鄂蘭(Hannah Arendt)說得對:「謊言往往比現實看起來真實多了,也更為合理,因為騙子握有巨大的優勢,能事先得知觀眾想聽見,也預期會聽見的東西。」

要避免犯CBS在小布希報導所犯的錯誤,就要問自己一個有些矛盾的問題:「這跟我預測的一樣嗎?」如果答案是「是,這跟我預測的一模一樣」,那就代表你應該確認得更多,而不是更少。確認的方法之一,是假設你的預期與實際發生的完全相反。CBS的記者看到伯克特提供的文件,若是認為小布希不會逃避應盡的職責,也許就較有可能質疑備忘錄的來源。若是以這種方式檢視支持先前想法的證據與論點,就會發現這些證據與論點往往站不住腳。

不過要假裝相信你並不相信的東西,其實很困難。另外還有一種方法,源自軍方與情報界,最近應用在科學界,就是邀集同僚擔任「紅隊」,負責抓出你思考的錯誤之處。美國中央情報局在建議歐巴馬總統發動2011年那場最終擊斃賓拉登的襲擊行動之前,選擇了多年來並未參與追捕賓拉登行動的四位情報分析師,挑戰中情局「賓拉登住在巴基斯坦阿伯塔巴德的一處院落」的結論。四位分析師評估其他三種假設的合理性,這三種假設都研判賓拉登不在院落裡。他們尋找這三種假設成立的理由,仍然認為賓拉登在院落的機率為40至60%。「紅隊」最終的結論,與中情局的研判類似。紅隊質疑的聲浪若是較大,這起行動很有可能就不會發生。